|

最新快照版本请使用Spring AI 1.1.0! |

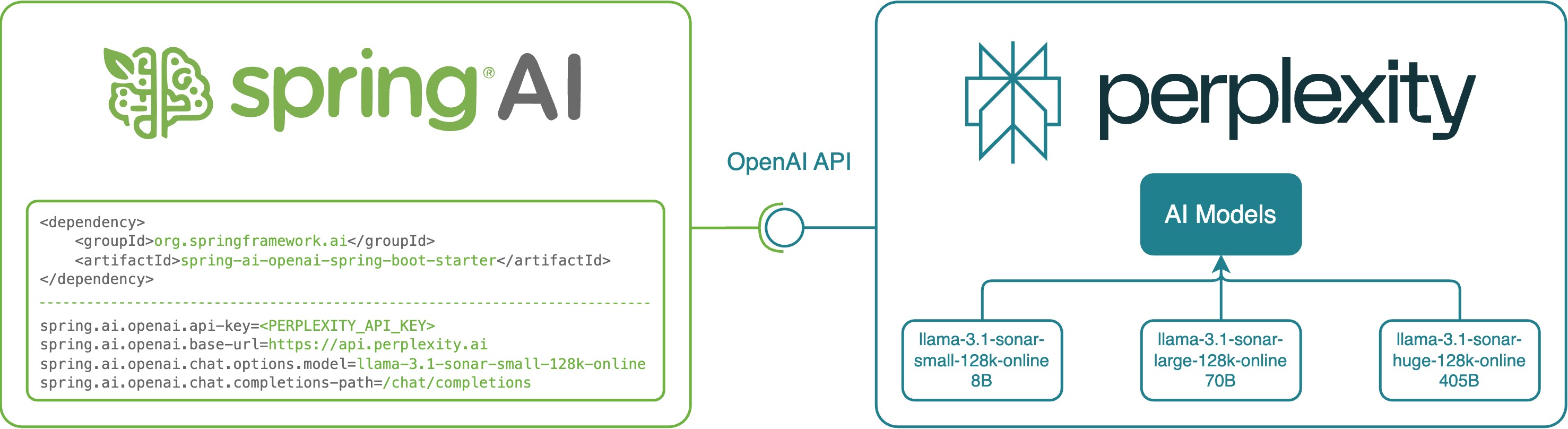

Perplexity Chart

Perplexity AI 提供了一项独特的 AI 服务,将其语言模型与实时搜索功能集成。它提供多种模型,并支持对话式AI的流式回应。

Spring AI 通过重用现有的 OpenAI 客户端与 Perplexity AI 集成。要开始,你需要获取一个 Perplexity API 密钥,配置基础 URL,并选择支持的模型之一。

Perplexity API 与 OpenAI API 并不完全兼容。

Perplexity 结合了实时的网页搜索结果与其语言模型的响应。

与OpenAI不同,Perplexity不会暴露工具调用 - 函数调用机制。

此外,目前 Perplexity 不支持多模态消息。 |

可以查看PerplexityWithOpenAiChatModelIT.java测试,了解如何用 Spring AI 使用 Perplexity。

前提条件

-

创建API密钥: 点击这里创建API密钥。 通过以下方式配置它

spring.ai.openai.api-key(春.ai.openai.api-key)你Spring AI项目中的属性。 -

设置 Perplexity Base URL: 设置

Spring.ai.openai.base-url属性到https://api.perplexity.ai. -

选择一个复杂度模型: 使用该

spring.ai.openai.chat.model=<model name>属性以指定模型。 请参阅支持型号以获取可用选项。 -

设置聊天补全路径: 设置

spring.ai.openai.chat.completions-path自/聊天/完成. 详情请参阅聊天补全API。

你可以在你的application.properties文件:

spring.ai.openai.api-key=<your-perplexity-api-key>

spring.ai.openai.base-url=https://api.perplexity.ai

spring.ai.openai.chat.model=llama-3.1-sonar-small-128k-online

spring.ai.openai.chat.completions-path=/chat/completions为了在处理敏感信息如 API 密钥时增强安全性,可以使用 Spring 表达式语言(SpEL)来引用自定义环境变量:

# In application.yml

spring:

ai:

openai:

api-key: ${PERPLEXITY_API_KEY}

base-url: ${PERPLEXITY_BASE_URL}

chat:

model: ${PERPLEXITY_MODEL}

completions-path: ${PERPLEXITY_COMPLETIONS_PATH}# In your environment or .env file

export PERPLEXITY_API_KEY=<your-perplexity-api-key>

export PERPLEXITY_BASE_URL=https://api.perplexity.ai

export PERPLEXITY_MODEL=llama-3.1-sonar-small-128k-online

export PERPLEXITY_COMPLETIONS_PATH=/chat/completions你也可以在应用代码中编程设置这些配置:

// Retrieve configuration from secure sources or environment variables

String apiKey = System.getenv("PERPLEXITY_API_KEY");

String baseUrl = System.getenv("PERPLEXITY_BASE_URL");

String model = System.getenv("PERPLEXITY_MODEL");

String completionsPath = System.getenv("PERPLEXITY_COMPLETIONS_PATH");自动配置

|

Spring AI自动配置、起始模块的工件名称发生了重大变化。 更多信息请参阅升级说明。 |

Spring AI 为 OpenAI 聊天客户端提供 Spring Boot 自动配置。

要启用它,请在项目的Maven中添加以下依赖pom.xml或者Gradlebuild.gradle构建文件:

-

Maven

-

Gradle

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-starter-model-openai</artifactId>

</dependency>dependencies {

implementation 'org.springframework.ai:spring-ai-starter-model-openai'

}| 请参考依赖管理部分,将Spring AI的物料清单添加到你的构建文件中。 |

聊天属性

重试属性

前缀spring.ai.retry作为属性前缀,用于配置OpenAI聊天模型的重试机制。

| 属性 | 描述 | 默认值 |

|---|---|---|

spring.ai.retry.max尝试 |

重试次数上限。 |

10 |

spring.ai.retry.backoff.initial-interval |

指数式退避政策的初始睡眠时长。 |

两秒钟。 |

spring.ai.retry.backoff.multiplier |

后退间隔倍数。 |

5 |

spring.ai.retry.backoff.max区间 |

最大退回时间。 |

3分钟。 |

spring.ai.retry.on-client-errors |

如果为假,抛出非瞬态AiException,且不要尝试重试 |

false |

spring.ai.retry.exclude-on-http-codes |

不应该触发重试的HTTP状态码列表(例如抛出非瞬态Ai异常)。 |

empty |

spring.ai.retry.on-http-codes |

应触发重试的HTTP状态码列表(例如抛出TransientAiException)。 |

empty |

连接性质

前缀春.ai.openai作为属性前缀,允许你连接到OpenAI。

| 属性 | 描述 | 默认值 |

|---|---|---|

Spring.ai.openai.base-url |

连接的网址。必须设置为 |

- |

spring.ai.openai.chat.api-key。 |

你的 Perplexity API 密钥 |

- |

配置属性

|

现在,启用和禁用聊天自动配置通过带有前缀的顶层属性进行配置 启用时,spring.ai.model.chat=openai(默认启用) 要禁用,可以选择 spring.ai.model.chat=none(或任何与 openai 不匹配的值) 此改动旨在允许配置多个模型。 |

前缀spring.ai.openai.chat是允许您配置OpenAI聊天模型实现的属性前缀。

| 属性 | 描述 | 默认值 |

|---|---|---|

spring.ai.model.chat |

启用OpenAI聊天模型。 |

OpenAI |

spring.ai.openai.chat.model |

支持的 Perplexity 模型之一。例: |

- |

spring.ai.openai.chat.base-url |

可选覆盖 spring.ai.openai.base-url,提供针对聊天的具体网址。必须设置为 |

- |

spring.ai.openai.chat.completions-path |

必须设置为 |

|

spring.ai.openai.chat.options.temperature. |

回答中的随机性,介于0包容和2排他之间。数值越高越随机,数值越低越确定。所需射程: |

0.2 |

spring.ai.openai.chat.options.frequency 惩罚 |

乘法惩罚大于0。值大于1.0会根据新标记在文本中已有的频率惩罚新标记,降低模型逐字重复同一行的可能性。值为1.0则无惩罚。与 presence_penalty 不兼容。所需射程: |

1 |

spring.ai.openai.chat.options.maxTokens |

API返回的最大完成Tokens数。max_tokens中请求的Tokens总数加上通过消息发送的提示Tokens数量不得超过所请求模型的上下文窗口Tokens限制。如果未指定,模型将持续生成Tokens,直到达到停止Tokens或上下文窗口结束。 |

- |

spring.ai.openai.chat.options.presence惩罚 |

值介于-2.0到2.0之间。正值会根据新Tokens是否出现在文本中来惩罚它们,从而提高模型讨论新话题的可能性。与 |

0 |

spring.ai.openai.chat.options.topP |

核采样阈值,值在0到1之间。对于每个后续的标记,模型考虑这些标记的结果,概率质量top_p。我们建议要么更改top_k要么top_p,但不要两者兼用。所需射程: |

0.9 |

spring.ai.openai.chat.options.stream-usage |

(仅限流媒体播放)设置为为整个请求添加一个额外的块,包含Tokens使用统计数据。这 |

false |

运行时选项

OpenAiChatOptions.java提供模型配置,如所用模型、温度、频率惩罚等。

启动时,默认选项可以配置为OpenAiChatModel(api, options)构造者或spring.ai.openai.chat.options.*性能。

运行时,你可以通过添加新的、请求专属的选项来覆盖默认选项,提示叫。

例如,针对特定请求覆盖默认型号和温度:

ChatResponse response = chatModel.call(

new Prompt(

"Generate the names of 5 famous pirates.",

OpenAiChatOptions.builder()

.model("llama-3.1-sonar-large-128k-online")

.temperature(0.4)

.build()

));| 除了模型特定的OpenAiChatOptions外,你还可以使用用ChatOptions#builder()创建的便携式ChatOptions实例。 |

采样控制器

创建一个新的 Spring Boot 项目并添加Spring-AI-starter-model-openai对你的POM(或Gradle)依赖。

添加一个application.properties文件,在src/主/资源目录,用于启用和配置OpenAi聊天模型:

spring.ai.openai.api-key=<PERPLEXITY_API_KEY>

spring.ai.openai.base-url=https://api.perplexity.ai

spring.ai.openai.chat.completions-path=/chat/completions

spring.ai.openai.chat.options.model=llama-3.1-sonar-small-128k-online

spring.ai.openai.chat.options.temperature=0.7

# The Perplexity API doesn't support embeddings, so we need to disable it.

spring.ai.openai.embedding.enabled=false替换API密钥用你的 Perplexity API 密钥。 |

这将产生OpenAiChatModel你可以把这些实现注入到你的类里。

这里有一个简单的例子@Controller使用聊天模式生成文本的课程。

@RestController

public class ChatController {

private final OpenAiChatModel chatModel;

@Autowired

public ChatController(OpenAiChatModel chatModel) {

this.chatModel = chatModel;

}

@GetMapping("/ai/generate")

public Map generate(@RequestParam(value = "message", defaultValue = "Tell me a joke") String message) {

return Map.of("generation", this.chatModel.call(message));

}

@GetMapping("/ai/generateStream")

public Flux<ChatResponse> generateStream(@RequestParam(value = "message", defaultValue = "Tell me a joke") String message) {

Prompt prompt = new Prompt(new UserMessage(message));

return this.chatModel.stream(prompt);

}

}支持的型号

Perplexity 支持多种针对搜索增强对话 AI 优化的模型。详情请参阅支持型号。